Gerade Kleine und Mittlere Unternehmen (KMU) können es sich oftmals nicht leisten, eigene Trainingsmodelle (Large Language Models) zu entwickeln. KMU greifen daher gerne auf bekannte Modelle wie ChatGPT usw. zurück.

Es wird allerdings gerade bei innovativen KMU immer klarer, dass es gefährlich sein kann, eigene Datenbestände in z.B. ChatGPT einzugeben. Da diese Modelle nicht transparent sind ist unklar, was mit den eigenen Daten passiert.

Eine Möglichkeit aus dem Dilemma herauszukommen ist, RAG (Retrieval-Augmented Generation) zu nutzen – also ein Basismodell mit einer internen Wissensbasis zu verknüpfen:

“Retrieval-Augmented Generation (RAG): Bei RAG wird ein Basismodell wie GPT-4, Jamba oder LaMDA mit einer internen Wissensbasis verknüpft. Dabei kann es sich um strukturierte Informationen aus einer Datenbank, aber auch um unstrukturierte Daten wie E-Mails, technische Dokumente, Whitepaper oder Marketingunterlagen handeln. Das Foundation Model kombiniert die Informationen mit seiner eigenen Datenbasis und kann so Antworten liefern, die besser auf die Anforderungen des Unternehmens zugeschnitten sind” (heise business services (2024): KI für KMU: Große Sprachmodelle erfolgreich einsetzen – mit Finetuning, RAG & Co.).

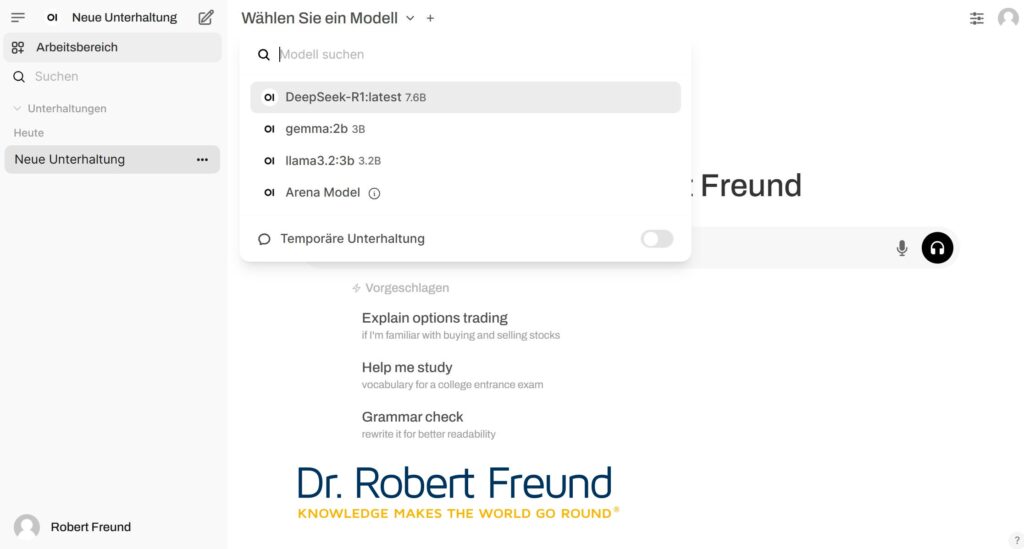

Wir gehen noch einen Schritt weiter, indem wir (1) einerseits LocalAI und Open Source AI mit einem Assistenten nutzen, und (2) darüber hinaus mit Hilfe von Ollama und Langflow eigene KI-Agenten entwickeln, die auf Basis von Open Source AI Modellen und beliebig konfigurierbaren eigenen Input einen gewünschten Output generieren In dem gesamten Prozess bleiben alle Daten auf unserem Server.