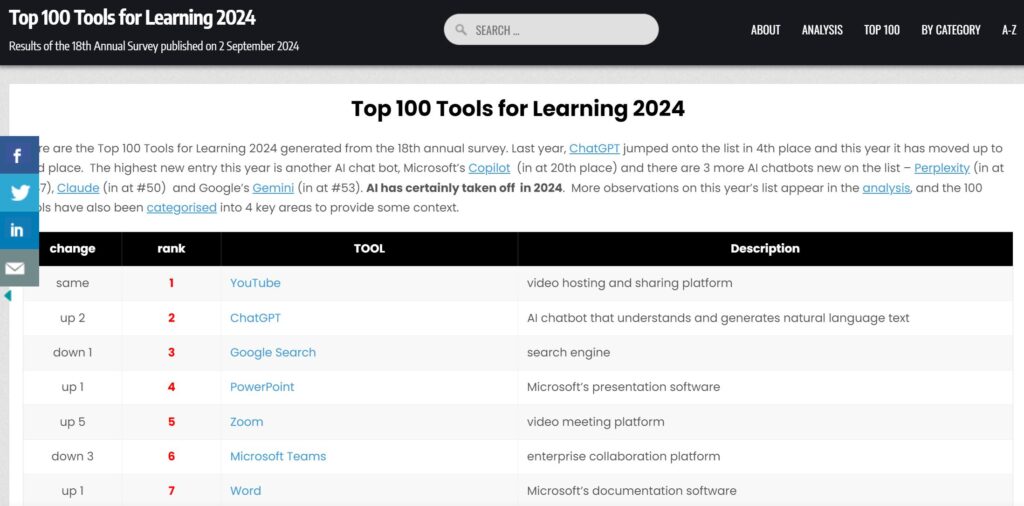

Es ist nicht verwunderlich, dass immer mehr KI-Anwendungen in der Liste der 100 Tools for Learning auftauchen. ChatGPT ist vom 4. auf den 2. Platz vorgerückt und weitere KI-Copilots tauchen in der Liste auf, bzw. rücken auch in den Platzierung vor. Es sieht so aus, als ob immer mehr KI-Anwendungen für Lernprozesse genutzt werden.

Es ist daher für viele an der Zeit, sich mit den Möglichkeiten und Beschränkungen von KI-Anwendungen bei Lernprozessen zu befassen. Am besten geht das in Unternehmen natürlich im Prozess der Arbeit: Kompetenzentwicklung im Prozess der Arbeit.

Erwähnen möchte ich hier, dass mir in der Liste Open-Source-KI-Anwendungen fehlen oder zu kurz kommen. Viele der KI-Anwendungen sind von Microsoft und Google dominiert, auch wenn z.B. ChatGPT von OpenAI ist und suggeriert, dass die Anwendung “Open” ist. Siehe dazu Open Source AI: Nun gibt es endlich eine Definition – und damit interessante Erkenntnisse zu OpenAI und Co. und Künstliche Intelligenz: Vorteile von Open Source Modellen.